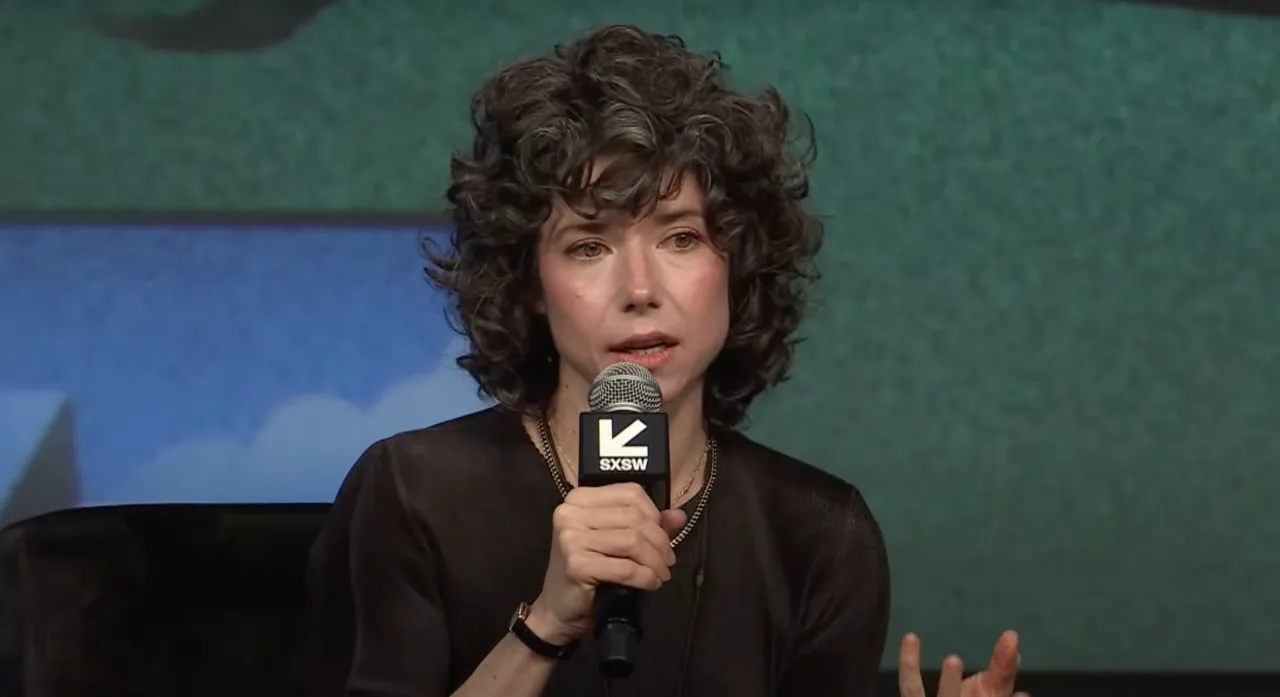

به گزارش رسانه تحلیلی خبری آناژورنال مردیت ویتاکر، رئیس اپلیکیشن پیامرسان سیگنال، روز جمعه ۱۷ اسفند ۱۴۰۳ در کنفرانس SXSW در آستین تگزاس هشدار داد که هوش مصنوعی خودکار (Agentic AI) میتونه تهدید بزرگی برای حریم خصوصی و امنیت کاربران باشه.

ویتاکر، که سالهاست از حامیان ارتباطات امن بوده، این فناوری رو به «قرار دادن مغز در شیشه» تشبیه کرد و گفت این مدل جدید محاسباتی، که در اون هوش مصنوعی به جای کاربر وظایف رو انجام میده، مشکلات عمیقی به همراه داره.

ویتاکر توضیح داد که شرکتها این فناوری رو بهعنوان راهی برای راحتتر کردن زندگی معرفی میکنن.

مثلاً این هوش مصنوعی میتونه کنسرت پیدا کنه، بلیت بخره، رویداد رو تو تقویم ثبت کنه و به دوستاتون پیام بده که همهچیز اوکیه.

«خب، دیگه میتونیم مغزم رو کنار بذاریم چون این ابزار همهچیز رو انجام میده، درسته؟» ویتاکر با طعنه این سؤال رو مطرح کرد.

اما بعدش توضیح داد که برای انجام این کارها، این هوش مصنوعی به دسترسی گستردهای نیاز داره: از مرورگر وب و اطلاعات کارت بانکی گرفته تا تقویم و اپلیکیشن پیامرسان.

ویتاکر هشدار داد: «این ابزار باید مثل یه دسترسی ریشهای (Root Permission) به همه سیستم نفوذ کنه و احتمالاً بدون رمزنگاری به همه پایگاههای داده دسترسی داشته باشه.»

اون اضافه کرد که مدلهای قدرتمند هوش مصنوعی نمیتونن رو دستگاه کاربر اجرا بشن و دادهها به سرورهای ابری فرستاده میشن، جایی که پردازش میشن و برمیگردن.

«این یعنی یه مشکل بزرگ برای امنیت و حریم خصوصی که زیر سایه تبلیغات این فناوری پنهان شده.»

ویتاکر تأکید کرد که اگه اپلیکیشنهایی مثل سیگنال بخواد از این هوش مصنوعی استفاده کنه، دیگه نمیتونه حریم خصوصی پیامها رو تضمین کنه.

چون این ابزار برای پیام دادن به دوستاتون باید به اپلیکیشن دسترسی پیدا کنه و حتی پیامها رو خلاصه کنه.

این موضوع با اصول اصلی سیگنال، که بر پایه رمزنگاری و امنیت بنا شده، در تضاده.

ویتاکر قبلاً تو این پنل گفته بود که صنعت هوش مصنوعی بر اساس مدل جمعآوری انبوه دادهها ساخته شده و پارادایم «هرچه داده بیشتر، بهتر» مشکلاتی جدی داره.

به نظر اون، این فناوری در ظاهر مثل یه «غول جادویی» معرفی میشه که زندگی رو راحتتر میکنه، اما در واقع امنیت و حریم خصوصی رو قربانی میکنه.

سوالات متداول:

هوش مصنوعی خودکار که رئیس سیگنال میگه چیه؟

یه نوع هوش مصنوعیه که به جات کاراتو انجام میده، مثل خرید بلیت یا پیام دادن، ولی نیاز به دسترسی به همه اطلاعات شخصيت داره.

چرا رئیس سیگنال میگه این هوش مصنوعی خطرناکه؟

چون به همهچیز دسترسی داره (مثل کارت بانکی و پیامهات) و دادههات رو بدون رمزنگاری به سرور میفرسته که امنیت رو به خطر میندازه.

اگه سیگنال از این هوش مصنوعی استفاده کنه چی میشه؟

پیامهات دیگه خصوصی نمیمونن، چون این ابزار باید به چتهات دسترسی داشته باشه و ممکنه امنیتش خراب بشه.

برای ما تو ایران این موضوع چه فرقی میکنه؟

اگه اپلیکیشنهای روزمرهمون از این فناوری استفاده کنن، اطلاعاتمون میتونه لو بره و تو کشوری مثل ایران که حریم خصوصی حساسه، ریسکش بالاست.

ارسال نقد و بررسی